Foram encontradas 50 questões.

Futuro da Inteligência Artificial e a necessidade da ética relacional para uma governança inclusiva

Estamos vivendo a era da datificação, em que todos os aspectos da vida social são transformados em dados. Esse processo, fundamental para o desenvolvimento da Inteligência Artificial (IA), nos promete um futuro onde decisões complexas podem ser automatizadas e otimizadas em uma escala sem precedentes. No entanto, isso frequentemente simplifica a complexidade da vida humana em métricas e números, ignorando as relações e os contextos que tornam cada indivíduo único. Quando esses dados são usados em sistemas de IA, eles podem acabar reforçando as mesmas desigualdades e exclusões que pretendiam resolver.

Os dados que alimentam esses sistemas muitas vezes refletem contextos históricos de desigualdade. Como Coté (2022) observa, ao moldar identidades e comportamentos humanos em padrões digitais, a datificação impõe limites às representações, limitando a diversidade de experiências humanas e, em muitos casos, perpetuando estereótipos. Isso pode resultar em decisões enviesadas, criando um ciclo de exclusão e discriminação. Esse desafio nos obriga a questionar a suposta neutralidade dos algoritmos e a refletir sobre como essas decisões automatizadas moldam a sociedade, frequentemente favorecendo certos grupos em detrimento de outros.

Pensando em uma governança que seja realmente inclusiva, Browne (2023) propõe a criação de “AI Public Body” – uma entidade pública que permite a participação de cidadãos comuns, especialmente daqueles mais afetados pelas tecnologias de IA, nas decisões sobre o uso dessas tecnologias. Inspirado em modelos de democracia deliberativa, esse corpo incluiria a voz de comunidades diversas, trazendo uma nova perspectiva para as decisões que, até hoje, são dominadas por especialistas técnicos.

Esse modelo representa uma mudança significativa na forma como entendemos a governança, enfatizando que a IA não deve ser apenas uma questão de precisão técnica, mas também de justiça e representatividade. A inclusão dessas vozes no processo de governança cria um espaço onde os efeitos sociais das tecnologias podem ser mais bem compreendidos e endereçados, resultando em uma governança que reflete a diversidade da sociedade.

A justiça algorítmica muitas vezes é tratada como uma questão de otimização matemática, ajustando dados e métricas para minimizar desigualdades estatísticas. No entanto, como Van Nuenen (2022) aponta, a justiça social na IA deve ir além dos ajustes técnicos, considerando as complexas desigualdades estruturais que esses dados representam. Em vez de se limitar a resultados estatísticos, a justiça social exige uma compreensão mais profunda do impacto das decisões tecnológicas na vida das pessoas.

No caso de algoritmos usados em concessão de crédito ou reconhecimento facial, é essencial entender que esses sistemas não operam em um vácuo: eles são parte de uma sociedade com uma longa história de desigualdade. Para que a IA seja realmente justa, ela deve ser projetada com o compromisso de mitigar essas desigualdades, considerando as realidades vividas por comunidades marginalizadas e integrando suas vozes no desenvolvimento e na aplicação dessas tecnologias.

(Carine Roos. Em: 08/02/2025. Disponível em: https://www.hojeemdia.com.br/opiniao. Fragmento.)

Considerando o primeiro parágrafo do texto, é correto afirmar que no encadeamento entre os períodos que o constituem pode-se observar, na introdução dos períodos, a partir do segundo:

Provas

Futuro da Inteligência Artificial e a necessidade da ética relacional para uma governança inclusiva

Estamos vivendo a era da datificação, em que todos os aspectos da vida social são transformados em dados. Esse processo, fundamental para o desenvolvimento da Inteligência Artificial (IA), nos promete um futuro onde decisões complexas podem ser automatizadas e otimizadas em uma escala sem precedentes. No entanto, isso frequentemente simplifica a complexidade da vida humana em métricas e números, ignorando as relações e os contextos que tornam cada indivíduo único. Quando esses dados são usados em sistemas de IA, eles podem acabar reforçando as mesmas desigualdades e exclusões que pretendiam resolver.

Os dados que alimentam esses sistemas muitas vezes refletem contextos históricos de desigualdade. Como Coté (2022) observa, ao moldar identidades e comportamentos humanos em padrões digitais, a datificação impõe limites às representações, limitando a diversidade de experiências humanas e, em muitos casos, perpetuando estereótipos. Isso pode resultar em decisões enviesadas, criando um ciclo de exclusão e discriminação. Esse desafio nos obriga a questionar a suposta neutralidade dos algoritmos e a refletir sobre como essas decisões automatizadas moldam a sociedade, frequentemente favorecendo certos grupos em detrimento de outros.

Pensando em uma governança que seja realmente inclusiva, Browne (2023) propõe a criação de “AI Public Body” – uma entidade pública que permite a participação de cidadãos comuns, especialmente daqueles mais afetados pelas tecnologias de IA, nas decisões sobre o uso dessas tecnologias. Inspirado em modelos de democracia deliberativa, esse corpo incluiria a voz de comunidades diversas, trazendo uma nova perspectiva para as decisões que, até hoje, são dominadas por especialistas técnicos.

Esse modelo representa uma mudança significativa na forma como entendemos a governança, enfatizando que a IA não deve ser apenas uma questão de precisão técnica, mas também de justiça e representatividade. A inclusão dessas vozes no processo de governança cria um espaço onde os efeitos sociais das tecnologias podem ser mais bem compreendidos e endereçados, resultando em uma governança que reflete a diversidade da sociedade.

A justiça algorítmica muitas vezes é tratada como uma questão de otimização matemática, ajustando dados e métricas para minimizar desigualdades estatísticas. No entanto, como Van Nuenen (2022) aponta, a justiça social na IA deve ir além dos ajustes técnicos, considerando as complexas desigualdades estruturais que esses dados representam. Em vez de se limitar a resultados estatísticos, a justiça social exige uma compreensão mais profunda do impacto das decisões tecnológicas na vida das pessoas.

No caso de algoritmos usados em concessão de crédito ou reconhecimento facial, é essencial entender que esses sistemas não operam em um vácuo: eles são parte de uma sociedade com uma longa história de desigualdade. Para que a IA seja realmente justa, ela deve ser projetada com o compromisso de mitigar essas desigualdades, considerando as realidades vividas por comunidades marginalizadas e integrando suas vozes no desenvolvimento e na aplicação dessas tecnologias.

(Carine Roos. Em: 08/02/2025. Disponível em: https://www.hojeemdia.com.br/opiniao. Fragmento.)

Acerca das informações e ideias apresentadas no último parágrafo do texto, é INCORRETO afirmar que:

Provas

Futuro da Inteligência Artificial e a necessidade da ética relacional para uma governança inclusiva

Estamos vivendo a era da datificação, em que todos os aspectos da vida social são transformados em dados. Esse processo, fundamental para o desenvolvimento da Inteligência Artificial (IA), nos promete um futuro onde decisões complexas podem ser automatizadas e otimizadas em uma escala sem precedentes. No entanto, isso frequentemente simplifica a complexidade da vida humana em métricas e números, ignorando as relações e os contextos que tornam cada indivíduo único. Quando esses dados são usados em sistemas de IA, eles podem acabar reforçando as mesmas desigualdades e exclusões que pretendiam resolver.

Os dados que alimentam esses sistemas muitas vezes refletem contextos históricos de desigualdade. Como Coté (2022) observa, ao moldar identidades e comportamentos humanos em padrões digitais, a datificação impõe limites às representações, limitando a diversidade de experiências humanas e, em muitos casos, perpetuando estereótipos. Isso pode resultar em decisões enviesadas, criando um ciclo de exclusão e discriminação. Esse desafio nos obriga a questionar a suposta neutralidade dos algoritmos e a refletir sobre como essas decisões automatizadas moldam a sociedade, frequentemente favorecendo certos grupos em detrimento de outros.

Pensando em uma governança que seja realmente inclusiva, Browne (2023) propõe a criação de “AI Public Body” – uma entidade pública que permite a participação de cidadãos comuns, especialmente daqueles mais afetados pelas tecnologias de IA, nas decisões sobre o uso dessas tecnologias. Inspirado em modelos de democracia deliberativa, esse corpo incluiria a voz de comunidades diversas, trazendo uma nova perspectiva para as decisões que, até hoje, são dominadas por especialistas técnicos.

Esse modelo representa uma mudança significativa na forma como entendemos a governança, enfatizando que a IA não deve ser apenas uma questão de precisão técnica, mas também de justiça e representatividade. A inclusão dessas vozes no processo de governança cria um espaço onde os efeitos sociais das tecnologias podem ser mais bem compreendidos e endereçados, resultando em uma governança que reflete a diversidade da sociedade.

A justiça algorítmica muitas vezes é tratada como uma questão de otimização matemática, ajustando dados e métricas para minimizar desigualdades estatísticas. No entanto, como Van Nuenen (2022) aponta, a justiça social na IA deve ir além dos ajustes técnicos, considerando as complexas desigualdades estruturais que esses dados representam. Em vez de se limitar a resultados estatísticos, a justiça social exige uma compreensão mais profunda do impacto das decisões tecnológicas na vida das pessoas.

No caso de algoritmos usados em concessão de crédito ou reconhecimento facial, é essencial entender que esses sistemas não operam em um vácuo: eles são parte de uma sociedade com uma longa história de desigualdade. Para que a IA seja realmente justa, ela deve ser projetada com o compromisso de mitigar essas desigualdades, considerando as realidades vividas por comunidades marginalizadas e integrando suas vozes no desenvolvimento e na aplicação dessas tecnologias.

(Carine Roos. Em: 08/02/2025. Disponível em: https://www.hojeemdia.com.br/opiniao. Fragmento.)

A escolha linguística para indicar o sujeito, agente da ação verbal, em “Estamos vivendo a era da datificação, [...]” (1º§) denota:

Provas

Futuro da Inteligência Artificial e a necessidade da ética relacional para uma governança inclusiva

Estamos vivendo a era da datificação, em que todos os aspectos da vida social são transformados em dados. Esse processo, fundamental para o desenvolvimento da Inteligência Artificial (IA), nos promete um futuro onde decisões complexas podem ser automatizadas e otimizadas em uma escala sem precedentes. No entanto, isso frequentemente simplifica a complexidade da vida humana em métricas e números, ignorando as relações e os contextos que tornam cada indivíduo único. Quando esses dados são usados em sistemas de IA, eles podem acabar reforçando as mesmas desigualdades e exclusões que pretendiam resolver.

Os dados que alimentam esses sistemas muitas vezes refletem contextos históricos de desigualdade. Como Coté (2022) observa, ao moldar identidades e comportamentos humanos em padrões digitais, a datificação impõe limites às representações, limitando a diversidade de experiências humanas e, em muitos casos, perpetuando estereótipos. Isso pode resultar em decisões enviesadas, criando um ciclo de exclusão e discriminação. Esse desafio nos obriga a questionar a suposta neutralidade dos algoritmos e a refletir sobre como essas decisões automatizadas moldam a sociedade, frequentemente favorecendo certos grupos em detrimento de outros.

Pensando em uma governança que seja realmente inclusiva, Browne (2023) propõe a criação de “AI Public Body” – uma entidade pública que permite a participação de cidadãos comuns, especialmente daqueles mais afetados pelas tecnologias de IA, nas decisões sobre o uso dessas tecnologias. Inspirado em modelos de democracia deliberativa, esse corpo incluiria a voz de comunidades diversas, trazendo uma nova perspectiva para as decisões que, até hoje, são dominadas por especialistas técnicos.

Esse modelo representa uma mudança significativa na forma como entendemos a governança, enfatizando que a IA não deve ser apenas uma questão de precisão técnica, mas também de justiça e representatividade. A inclusão dessas vozes no processo de governança cria um espaço onde os efeitos sociais das tecnologias podem ser mais bem compreendidos e endereçados, resultando em uma governança que reflete a diversidade da sociedade.

A justiça algorítmica muitas vezes é tratada como uma questão de otimização matemática, ajustando dados e métricas para minimizar desigualdades estatísticas. No entanto, como Van Nuenen (2022) aponta, a justiça social na IA deve ir além dos ajustes técnicos, considerando as complexas desigualdades estruturais que esses dados representam. Em vez de se limitar a resultados estatísticos, a justiça social exige uma compreensão mais profunda do impacto das decisões tecnológicas na vida das pessoas.

No caso de algoritmos usados em concessão de crédito ou reconhecimento facial, é essencial entender que esses sistemas não operam em um vácuo: eles são parte de uma sociedade com uma longa história de desigualdade. Para que a IA seja realmente justa, ela deve ser projetada com o compromisso de mitigar essas desigualdades, considerando as realidades vividas por comunidades marginalizadas e integrando suas vozes no desenvolvimento e na aplicação dessas tecnologias.

(Carine Roos. Em: 08/02/2025. Disponível em: https://www.hojeemdia.com.br/opiniao. Fragmento.)

A forma como a temática é abordada no texto apresenta aspectos não apenas positivos, mas situações que muitas vezes apontam certa preocupação. Representa(m) o exposto anteriormente:

Provas

A instituição XYZ, estabelecida no município de Nova Iguaçu, foi notificada a apresentar à Secretaria responsável, informações fiscais sobre os serviços prestados, intermediados e tomados relacionados ao Imposto sobre Serviços de Qualquer Natureza, nos termos do que dispõe o Código Tributário do Município de Nova Iguaçu – Lei Complementar nº 3.411/2002 a respeito das declarações fiscais. Sobre o caso hipotético narrado, assinale a afirmativa correta.

Provas

O Modelo de Três Linhas, do Institute of Internal Auditors-IIA, ajuda as organizações a identificarem estruturas e processos que melhor auxiliam no atingimento dos objetivos e facilitam uma forte governança e gerenciamento de riscos. A auditoria interna presta avaliação e assessoria independentes e objetivas sobre adequação e eficácia da governança e do gerenciamento de riscos. Isso é feito através da aplicação competente de processos sistemáticos e disciplinados, expertise e conhecimentos. Tício atuará como auditor na HJK Indústria e Comércio S.A. e buscará estabelecer a independência da auditoria interna em relação a responsabilidades da gestão, que é fundamental para sua objetividade, autoridade e credibilidade, por meio das seguintes ações/fatores descritos no Modelo de Três Linhas, EXCETO:

Provas

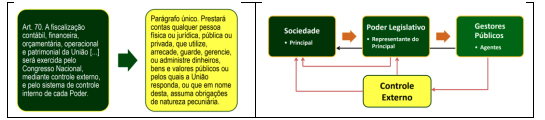

O auditor de controle interno municipal deverá compreender plenamente os aspectos legais e infralegais inerentes ao controle externo, especialmente no que se refere à Constituição Federal de 1988 e à Lei Orgânica do Tribunal de Contas da União (TCU). Assim, tendo em vista a figura a seguir e, ainda, sobre o controle interno e controle externo da administração pública, marque V para as afirmativas verdadeiras e F para as falsas.

(Disponível em: portal.tcu.gov.br. Acesso em: janeiro de 2025.)

( ) Auditoria interna é parte do sistema de controle interno da organização, mas não é sua a responsabilidade pelos controles internos; essa responsabilidade é dos gestores.

( ) Não se deve confundir o controle interno administrativo com o órgão ou unidade de controle interno ou de auditoria interna, cuja função é avaliar a qualidade dos outros controles implantados pelos gestores.

( ) A responsabilidade das unidades/órgãos de controle ou auditoria interna é avaliar a consistência, a qualidade e a suficiência dos controles internos implantados pelos gestores.

( ) Órgãos ou unidades de controle interno não são unidades administrativas, haja vista estarem incumbidos, exclusivamente, de prestar apoio às atividades de controle externo exercidas pelos Tribunais de Contas.

A sequência está correta em

Provas

O auditor de controle interno de determinado município, ao executar suas atribuições de verificação, acompanhamento e providências para correção dos atos administrativos e de gestão fiscal produzidos pelos órgãos e autoridades no âmbito do Poder Executivo Municipal, observou que alguns créditos tributários e não tributários em favor da Fazenda Pública, não recebidos no prazo para pagamento definido em lei, após apuração de certeza e liquidez, foram erroneamente inscritos. A fim de efetuar a devida correção, o auditor esclareceu que a correta inscrição deverá ser em:

Provas

Disciplina: Administração Financeira e Orçamentária

Banca: Consulplan

Orgão: Pref. Nova Iguaçu-RJ

Considere que os servidores de determinada prefeitura municipal estão com dificuldades de compreender os procedimentos necessários e legais a serem adotados na arrecadação da receita orçamentária. O chefe do Poder Executivo, preocupado com a situação, determinou que os auditores municipais de controle interno efetuassem uma avaliação, a fim de sanar as dúvidas e sugerir procedimentos que auxiliassem os servidores na condução das atividades diárias em relação às providências a serem adotadas na arrecadação. Após uma avaliação diagnóstica, os auditores concluíram que o maior problema estava relacionado às fases da receita pública, especificamente quanto ao momento do registro da receita orçamentária. Após os devidos esclarecimentos, é correto afirmar que o registro da receita orçamentária deverá ser efetuado na fase de:

Provas

A implantação de um sistema de controle interno municipal tem por finalidade sistematizar e implementar as práticas de todos os envolvidos na administração, visando ao cumprimento dos princípios fundamentais da administração pública. O sistema de controle interno busca verificar a pertinência e a eficiência dos controles realizados pelos diversos setores da administração. Por sua vez, a auditoria de controle interno tem atribuições bem mais amplas e, por isso, deve estar atenta aos fundamentos legais e técnicos da contabilidade pública. A esse respeito, analise as afirmativas a seguir.

I. Dentre os objetivos da contabilidade pública, descortina-se a necessidade de evidenciar, com qualidade, os fenômenos patrimoniais e a busca por um tratamento contábil padronizado dos atos e fatos administrativos no âmbito do setor público, o que torna imprescindível a elaboração de um plano de contas com abrangência nacional, que obriga todos os entes federativos e todos os poderes. Esse plano apresenta metodologia, estrutura, regras, conceitos e funcionalidades que possibilitam a obtenção de dados que atendam aos diversos usuários da informação contábil.

II. O objetivo da elaboração e da divulgação da informação contábil é disponibilizar informações para fins de prestação de contas, de responsabilização (accountability) e para tomada de decisão. As características qualitativas das informações contábeis são atributos que as tornam úteis para os usuários.

III. Quanto aos aspectos conceituais do que sejam características qualitativas das informações contábeis, tem-se que ela é integrada e funciona em conjunto com as características quantitativas. Na prática, talvez não seja possível alcançar todas as características qualitativas e, nesse caso, um equilíbrio ou compensação entre algumas delas poderá ser necessário.

Está correto o que se afirma em

Provas

Caderno Container