Foram encontradas 150 questões.

Considere o seguinte problema.

Maximize !$ Z_1(x_1,x_2)=3x_1+x_2 !$

e maximize !$ Z_2(x_1,x_2)=-x_1+x_2 !$

sujeito às restrições: !$ \begin{matrix} 6x_1 + 2x_2 \le 12 \\ x_1+x_2 \le 10 \\ x_1 \ge 0, x_2 \ge 0 \end{matrix} !$

Julgue o item a seguir, que tratam da solução do problema apresentado.

Um dos vértices da região viável é a origem.

Provas

Dois métodos novos para a produção de biocombustível estão sendo testados. O primeiro método é indicado por X = 1, e o segundo, por X = 0. A qualidade do combustível é medida por um indicador Y, que é uma variável aleatória distribuída segundo uma distribuição normal. Um estudo foi realizado para ajustar um modelo na forma Y = aX + b + !$ \epsilon !$, em que a e b são os coeficientes do modelo e g é o erro aleatório com média zero e variância F2. Os coeficientes do modelo foram estimados por mínimos quadrados ordinários. Os resultados do ajuste e algumas estatísticas descritivas estão apresentados nas tabelas a seguir.

| estimativa do | erro-padrão da estimativa | P-valor do teste t para a |

| !$ \hat{b} !$ = 21,7 | 0,35 | 0,0001 |

| !$ \hat {a} !$ = 4,0 | 0,45 | 0,0001 |

| variável | média amostral | desvio-padrão amostral |

| X | 0,5 | 0,5 |

| Y | 24,0 | 2,5 |

Com base nas informações apresentadas acima, julgue o item que se segue.

A distribuição condicional Y | X = 0 segue uma distribuição normal cuja variância é igual a !$ \sigma^2 !$.

Provas

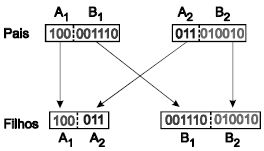

Algoritmos genéticos formam uma classe particular de algoritmos evolutivos, em que são utilizadas técnicas inspiradas na biologia evolutiva, tais como hereditariedade, mutação, seleção natural e recombinação (crossing over). Suponha-se que dois indivíduos, pai e mãe, sejam formados pelos conjuntos de genes (A1, B1) e (A2, B2) e, respectivamente, representados pelos binários a seguir.

![]()

Considerando essas informações, julgue o próximo item.

A figura abaixo representa corretamente uma possível aplicação do operador cross-over (cruzamento) em um algoritmo genético usual.

Provas

A simulação numérica como otimização de processos é um problema matemático e computacionalmente complexo, pois, em geral, as funções de custo ou objetivo são dependentes de uma grande quantidade de parâmetros, em cujo espaço de busca elas representam hipersuperfícies com um mínimo global e vários mínimos locais. Para esse tipo de problema, os métodos gradientes ou derivativos não são os mais convenientes, visto que fornecem informações apenas de mínimos locais. Nesse caso, é necessária a utilização de métodos de otimização globais, os quais permitem mapear-se a hipersuperfície da função objetivo, visando-se à busca do mínimo global ou absoluto. Hoje, existe uma variedade de métodos com tais características, entre os quais estão os métodos heurísticos e meta-heurísticos, tais como a busca tabu, o algoritmo genético e o simulated annealing (SA).

O método de otimização SA foi proposto, inicialmente, por Kirkpatrick e colaboradores. Alguns anos depois, o desempenho desse procedimento foi melhorado pelos pesquisadores H. Szu e R. Hartley, cujo método ficou conhecido como fast simulated annealing (FSA). Em 1996, Tsallis, Stariolo e Mundim propuseram a generalização do SA e a aplicaram a diferentes problemas. Esse método ficou conhecido como GSA, do inglês generalized simulated annealing e tem como caso particular os métodos propostos por Kirkpatrick e Szu. No método GSA, diferentes distribuições de probabilidades podem ser obtidas, variando-se o parâmetro q de Tsallis.

Considerando as informações do texto acima, julgue o item a seguir.

Assim como nos métodos derivativos ou gradientes, o simulated annealing depende da derivada da função custo ou objetivo.

Provas

Considere que X1, X2, ..., Xn seja uma série temporal estacionária com média zero e função de auto-covariância !$ \gamma !$(h) > 0, em que h !$ \ge !$ 1. Deseja-se construir um preditor linear para a observação futura Xn+h(h !$ \ge !$ 1) que dependa apenas da última observação disponível, isto é, !$ \hat{X} !$n+h = !$ \beta !$Xn + c, em que !$ \beta !$ e c são números reais.

Com base nessas informações, julgue o item subseqüente.

A média amostral !$ \dfrac{X_1+X_2+ ... + X_n}{n} !$ não é um estimador consistente da média do processo, mesmo que !$ lim_{h \rightarrow +\infty} \gamma(h)=0 !$

Provas

A taxa de octano existente em determinado combustível é uma variável aleatória X cuja distribuição possui média !$ \mu !$ e desvio-padrão F. Uma amostra aleatória simples fornecida por dez distribuidores diferentes desse combustível resultou nos valores apresentados na tabela a seguir.

| amostra | taxa de octano ( em %) |

| 1 | 90 |

| 2 | 96 |

| 3 | 92 |

| 4 | 87 |

| 5 | 85 |

| 6 | 85 |

| 7 | 90 |

| 8 | 92 |

| 9 | 93 |

| 10 | 90 |

Considerando as informações acima, julgue o item subseqüente.

Caso seja utilizado o teste t para testar as hipóteses H0: !$ \mu \ge !$ 89% versus H1: !$ \mu !$ < 89%, é correto afirmar que a hipótese nula não seria rejeitada ao se fixar níveis de significância inferiores a 50%.

Provas

A simulação numérica como otimização de processos é um problema matemático e computacionalmente complexo, pois, em geral, as funções de custo ou objetivo são dependentes de uma grande quantidade de parâmetros, em cujo espaço de busca elas representam hipersuperfícies com um mínimo global e vários mínimos locais. Para esse tipo de problema, os métodos gradientes ou derivativos não são os mais convenientes, visto que fornecem informações apenas de mínimos locais. Nesse caso, é necessária a utilização de métodos de otimização globais, os quais permitem mapear-se a hipersuperfície da função objetivo, visando-se à busca do mínimo global ou absoluto. Hoje, existe uma variedade de métodos com tais características, entre os quais estão os métodos heurísticos e meta-heurísticos, tais como a busca tabu, o algoritmo genético e o simulated annealing (SA).

O método de otimização SA foi proposto, inicialmente, por Kirkpatrick e colaboradores. Alguns anos depois, o desempenho desse procedimento foi melhorado pelos pesquisadores H. Szu e R. Hartley, cujo método ficou conhecido como fast simulated annealing (FSA). Em 1996, Tsallis, Stariolo e Mundim propuseram a generalização do SA e a aplicaram a diferentes problemas. Esse método ficou conhecido como GSA, do inglês generalized simulated annealing e tem como caso particular os métodos propostos por Kirkpatrick e Szu. No método GSA, diferentes distribuições de probabilidades podem ser obtidas, variando-se o parâmetro q de Tsallis.

Considerando as informações do texto acima, julgue o item a seguir.

A diferença básica entre os métodos de otimização de sistemas físicos denominados Monte Carlo e GSA é que, neste, a temperatura varia com o tempo.

Provas

Considere o seguinte problema.

Maximize !$ Z_1(x_1,x_2)=3x_1+x_2 !$

e maximize !$ Z_2(x_1,x_2)=-x_1+x_2 !$

sujeito às restrições: !$ \begin{matrix} 6x_1 + 2x_2 \le 12 \\ x_1+x_2 \le 10 \\ x_1 \ge 0, x_2 \ge 0 \end{matrix} !$

Julgue o item a seguir, que tratam da solução do problema apresentado.

O valor ótimo da função objetivo Z1 é maior que o valor ótimo da função objetivo Z2.

Provas

Considere que X1, X2, ..., Xn seja uma série temporal estacionária com média zero e função de auto-covariância !$ \gamma !$(h) > 0, em que h !$ \ge !$ 1. Deseja-se construir um preditor linear para a observação futura Xn+h(h !$ \ge !$ 1) que dependa apenas da última observação disponível, isto é, !$ \hat{X} !$n+h = !$ \beta !$Xn + c, em que !$ \beta !$ e c são números reais.

Com base nessas informações, julgue o item subseqüente.

A variância do processo é igual a [!$ \gamma !$(0)]2.

Provas

A simulação numérica como otimização de processos é um problema matemático e computacionalmente complexo, pois, em geral, as funções de custo ou objetivo são dependentes de uma grande quantidade de parâmetros, em cujo espaço de busca elas representam hipersuperfícies com um mínimo global e vários mínimos locais. Para esse tipo de problema, os métodos gradientes ou derivativos não são os mais convenientes, visto que fornecem informações apenas de mínimos locais. Nesse caso, é necessária a utilização de métodos de otimização globais, os quais permitem mapear-se a hipersuperfície da função objetivo, visando-se à busca do mínimo global ou absoluto. Hoje, existe uma variedade de métodos com tais características, entre os quais estão os métodos heurísticos e meta-heurísticos, tais como a busca tabu, o algoritmo genético e o simulated annealing (SA).

O método de otimização SA foi proposto, inicialmente, por Kirkpatrick e colaboradores. Alguns anos depois, o desempenho desse procedimento foi melhorado pelos pesquisadores H. Szu e R. Hartley, cujo método ficou conhecido como fast simulated annealing (FSA). Em 1996, Tsallis, Stariolo e Mundim propuseram a generalização do SA e a aplicaram a diferentes problemas. Esse método ficou conhecido como GSA, do inglês generalized simulated annealing e tem como caso particular os métodos propostos por Kirkpatrick e Szu. No método GSA, diferentes distribuições de probabilidades podem ser obtidas, variando-se o parâmetro q de Tsallis.

Considerando as informações do texto acima, julgue o item a seguir.

Considere-se que f (s) seja uma função objetivo. No método SA, começa-se a busca a partir de uma solução inicial qualquer f (s) e o procedimento principal consiste em produzir um loop, ou laço, que gera aleatoriamente, em cada iteração, um vizinho s’ da solução corrente s. A cada geração de um novo vizinho s’ de s, é testada a variação ) do valor da função objetivo, isto é !$ \Delta = f(s') - f(s) !$. Aceitar sempre os valores negativos de !$ \Delta !$ significa maximizar a função custo.

Provas

Caderno Container